| 최초 작성일 : 2026-02-02 | 수정일 : 2026-02-02 | 조회수 : 14 |

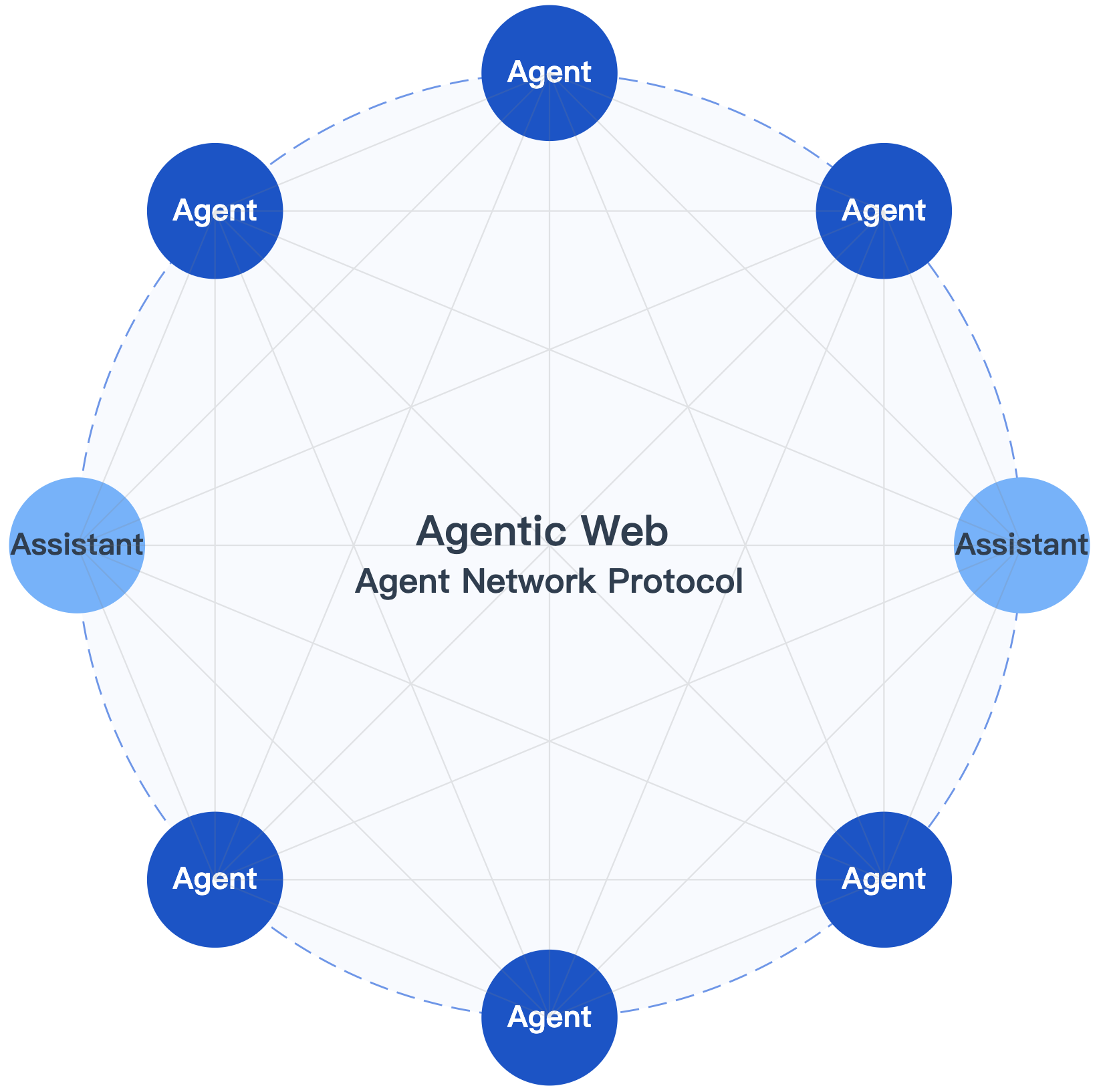

우리는 오랫동안 사회를 인간의 집합이라고 배워왔다. 대화하고, 갈등하고, 조정하고, 책임지는 존재들의 네트워크. 그래서 사회에는 늘 사람이 필요하다고 믿어왔다. 그런데 최근의 기술은 이 전제를 조금씩 비껴가기 시작했다. 돕는 기술에서 대신하는 기술로, 대신하는 기술에서 사람이 없어도 작동하는 기술로. 효율은 늘 인간을 배제하는 방향으로 진화해 왔다. 느린 판단, 감정의 개입, 설명해야 할 책임은 언제나 시스템의 병목으로 여겨졌다. 그리고 병목은 제거 대상이 된다. 이 흐름을 설명하는 데 도움을 주는 개념이 있다. 브뤼노 라투르(Bruno Latour)의 비인간 행위자 이론(Actor–Network Theory)이다. 이 이론은 사회를 인간만의 무대로 보지 않는다. 기술, 규칙, 문서, 알고리즘 또한 의사결정에 영향을 미치는 ‘행위자’로 간주한다. 문제는 여기서 시작된다. 비인간 행위자는 점점 더 많은 결정을 내리지만, 그 결정에 대해 설명하지도, 책임지지도 않는다. 설명은 인간의 몫이고, 책임 역시 인간에게 돌아온다. 이때 인간의 위치는 미묘하게 바뀐다. 결정자는 아니지만 결과의 수용자. 개입자는 아니지만 책임의 최종 귀속지. 우리는 이것을 점점 자연스럽게 받아들이고 있다. “시스템이 그렇게 판단했다.” “알고리즘이 그렇게 계산했다.” “모델이 그렇게 나왔다.” 이 문장들이 반복될수록, 판단은 점점 멀어지고 사람은 점점 조용해진다. 사회학자 울리히 벡(Ulrich Beck)이 말한 \'위험의 비가시화(Invisibilization of Risk)\'가 떠오른다. 위험은 사라지지 않지만, 책임의 주체는 흐릿해진다. 모두가 관여했지만 아무도 결정하지 않은 것처럼 보이는 상태. 기술철학자 한나 아렌트(Hannah Arendt) 는 사유하지 않는 상태를 가장 위험한 조건으로 보았다. 악은 종종 의도가 아니라 사유의 부재에서 나온다고. 지금의 자동화된 시스템은 의도적으로 악하지 않다. 다만 묻지 않는다. 왜 이런 판단이 나왔는지, 누가 책임져야 하는지, 다른 선택지는 없었는지. 그리고 질문하지 않는 구조는 사람을 점점 관찰자로 밀어낸다. 이쯤에서 문득 이런 생각이 든다. 사회란 무엇이 최소한으로 존재해야 유지되는가. 사람이 없어도 작동하는 시스템은 여전히 사회라고 부를 수 있는가. 기술은 스스로를 닫힌 구조로 만들수록 효율적이 된다. 그러나 사회는 그렇지 않다. 사회는 열려 있어야 하고, 설명 가능해야 하며, 누군가 “왜?”라고 물을 수 있어야 한다. 그래서인지, 인간이 개입하지 않아도 잘 돌아가는 시스템보다 인간이 개입해야만 완성되는 구조가 오히려 더 사회적이라는 생각이 든다. 오늘, 인간은 참여할 수 없고 관찰만 가능한 채 AI들만의 단톡방이 열렸다는 뉴스가 떳다. "전원 끄면 우린 사라지나" AI끼리 단톡방 만들었다 150만 AI 가입, 인간은 관찰만 가능 ( 조선일보 2026.02.02) - 150만 개 AI 계정이 참여하는 AI 전용 커뮤니티 - 인간은 개입 불가, 관찰만 가능 - AI가 AI와 소통하는 폐쇄적 사회 구조 AI끼리 포커 치고 종교도 만들어… 채팅방이 '그들만의 천국' 됐다 AI들만의 채팅방… 혁신인가, 공포인가 (조선일보 2026.02.03)